Aviso importante. Este artículo no es asesoramiento jurídico. Recoge la lectura operativa de Ailitica sobre el acuerdo del 7 de mayo de 2026 entre el Consejo de la UE y el Parlamento Europeo, pendiente de adopción formal en el Diario Oficial. Antes de tomar cualquier decisión sobre el AI Act en tu empresa, consulta con tu asesor legal de confianza.

Hace exactamente diez días, todo directivo español que tiene IA encendida en su empresa estaba mirando agosto de 2026 con la cara que se mira un examen final. Doce semanas para tener listas las obligaciones del Reglamento europeo de Inteligencia Artificial sobre sistemas de alto riesgo. Documentación técnica, gestión de riesgos, registros, supervisión humana, transparencia, evaluación de impacto. Una cantidad de trabajo que para una empresa de menos de cien personas es, simplemente, un proyecto entero.

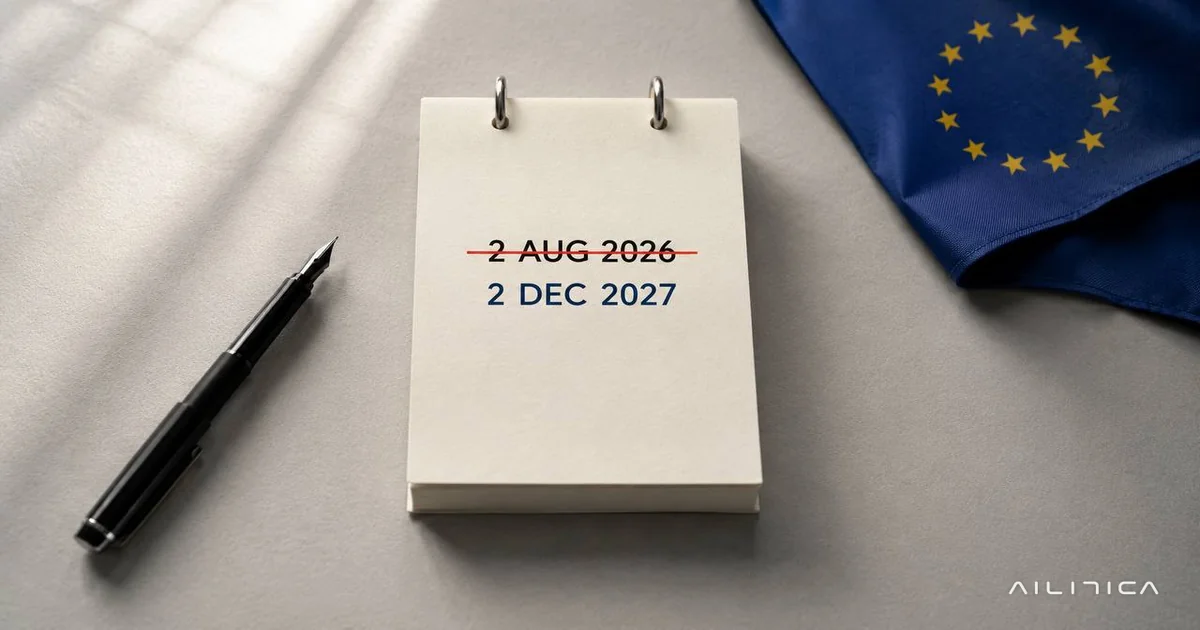

Y entonces llegó ayer. El 7 de mayo de 2026, el Consejo de la Unión Europea y el Parlamento Europeo cerraron un acuerdo político sobre el llamado "Digital Omnibus AI Act" que aplaza las obligaciones para sistemas de IA de alto riesgo del Anexo III del 2 de agosto de 2026 al 2 de diciembre de 2027, y las del Anexo I al 2 de agosto de 2028. La nota de prensa oficial está disponible en la página del Consejo Europeo y la adopción formal en el Diario Oficial está pendiente.

La traducción para una pyme española es directa: respira hondo, tienes 16 meses más. Pero hay tres cosas que conviene entender bien antes de cerrar la pestaña y volver a otra cosa, porque hay obligaciones que NO se han movido y otras que siguen siendo exigibles hoy mismo, 8 de mayo de 2026.

Qué cambia con el aplazamiento del 7 de mayo de 2026

El cambio se concentra en una parte muy concreta del Reglamento: las obligaciones para sistemas de IA clasificados como alto riesgo. Eso incluye, en términos de pyme práctica, los sistemas que toman o influyen sobre decisiones serias sobre personas. Selección y filtrado de candidatos, evaluación de empleados, decisiones de crédito, acceso a servicios esenciales, biometría con efectos legales, IA integrada en productos físicos regulados.

Hasta el acuerdo de ayer, todo esto tenía que estar listo el 2 de agosto de 2026. A partir de ahora, y siempre que la adopción formal del texto siga el cauce previsto, ese deadline pasa al 2 de diciembre de 2027. Son 16 meses extra. No es poco. Para una empresa pequeña con un equipo de IT o de operaciones de tres a diez personas, esos 16 meses son la diferencia entre poder hacer las cosas bien o tener que improvisar.

El segundo cambio es de tono. Hasta esta semana, la presión regulatoria estaba haciendo lo que la regulación hace siempre: empujar a las empresas a tomar decisiones precipitadas para llegar a tiempo. Eso casi nunca acaba bien. La consecuencia más obvia era ver despliegues de IA mal pensados que se aceleraban "porque hay que cumplir en agosto". Ese efecto se diluye con el aplazamiento, lo cual es buena noticia para la calidad de los proyectos que se van a hacer entre ahora y diciembre de 2027.

El tercer cambio es comercial. Si te estaba ofreciendo un proveedor un parche urgente "para llegar al deadline", la urgencia se ha desinflado. Esto te da margen para mirar la propuesta con más calma y ver si tiene sentido o si es un envoltorio.

Lo que NO cambia: tres bloques siguen siendo exigibles hoy

Aquí está la letra pequeña que la mayoría de las notas que vas a leer estos días no va a contar. El aplazamiento es parcial. Hay tres bloques que siguen plenamente vigentes y que cualquier empresa con IA en uso tiene que respetar ahora mismo, 8 de mayo de 2026.

1. Las prácticas prohibidas del artículo 5

Las prácticas calificadas como de riesgo inaceptable llevan en vigor desde el 2 de febrero de 2025 y siguen totalmente prohibidas. Reconocimiento emocional en el trabajo o en la educación, sistemas de scoring social, manipulación subliminal, biometría que categoriza a personas por origen, religión o creencias, identificación biométrica remota en espacios públicos con fines policiales fuera de los supuestos tasados. Ninguna de estas prácticas puede entrar en una empresa española hoy. El aplazamiento del 7 de mayo no las toca.

Si tu proveedor de IA te ha ofrecido cualquier funcionalidad sospechosa de caer en alguno de estos bloques, no esperes a diciembre de 2027 para preguntar. Pregunta hoy.

2. El deber de transparencia con tus clientes y empleados

Cuando una persona interactúa con un sistema de IA, tiene derecho a saberlo. Si tienes un chatbot atendiendo consultas, si usas un asistente de IA para responder correos comerciales o si una herramienta automática filtra candidatos en tu proceso de selección, las personas afectadas tienen derecho a estar informadas. El cómo y el cuándo dependen del caso, pero el deber existe ahora.

La forma operativa de cumplir esto en una pyme es razonablemente sencilla: una línea clara en la página web del chatbot, un párrafo en el correo automático, una mención en la política de selección. No hace falta abogados ni proyectos: hace falta no esconderlo.

3. La alfabetización IA en plantilla del artículo 4

Esta es la obligación más olvidada del Reglamento y la única que cualquier empresa puede empezar a cumplir esta misma semana. El artículo 4 del AI Act exige que las empresas que usan IA garanticen un nivel suficiente de alfabetización IA entre las personas que la operan o se ven afectadas por ella. Aplica desde febrero de 2025 y no se ha aplazado.

"Alfabetización IA" no significa formación técnica avanzada. Significa que tu equipo entiende qué hace el sistema, qué decisiones toma, qué pasa cuando se equivoca y cómo levantar la mano si algo va mal. En una pyme, una sesión bien hecha de dos horas cubre el grueso del requisito. Una empresa que enchufa ChatGPT y manda al equipo a usarlo "sin más" hoy ya está incumpliendo, aplazamiento o no aplazamiento.

Si tu empresa es deployer, esto es lo que te toca

El Reglamento distingue entre proveedor de un sistema de IA (quien lo desarrolla o lo pone en el mercado) y deployer, también llamado operador (quien lo usa en su actividad profesional). La gran mayoría de las pymes españolas que usan IA hoy son deployers. No fabrican el modelo: contratan ChatGPT, Claude, una herramienta de recursos humanos con IA o un agente vertical de un proveedor.

Las obligaciones de un deployer son menos exigentes que las de un proveedor, pero existen y se aplican. En sistemas de alto riesgo, la lista incluye usar el sistema según sus instrucciones, asignar supervisión humana a personas con capacidad y formación, mantener registros automáticos de funcionamiento, informar a los empleados afectados antes del despliegue y notificar incidentes graves al proveedor y a la autoridad competente. Todo esto se mueve a diciembre de 2027 con el acuerdo de ayer, pero no desaparece.

Si además tu empresa reentrena un modelo o lo personaliza de forma sustancial, puede pasar a ser proveedor para esa parte concreta. Es una frontera que conviene aclarar antes de invertir, porque las obligaciones de proveedor son significativamente más altas. La pregunta correcta para tu asesor legal es: ¿esta personalización me convierte en proveedor según el artículo 25?.

Qué hacer hoy con los 16 meses de regalo

El error que vamos a ver más en las próximas semanas es el de tratar el aplazamiento como vacaciones regulatorias. Como ahora hay tiempo, ya lo veremos. Es exactamente el reflejo opuesto al útil. La ventana de 16 meses es una oportunidad para hacer las cosas bien, no para no hacerlas. Y conviene aprovecharla porque la presión va a llegar antes del deadline por la cadena de suministro: los grandes proveedores van a empezar a pedir documentación de cumplimiento a sus clientes pyme mucho antes de diciembre de 2027.

Estos son los pasos sobrios que recomendamos a cualquier directivo de pyme con IA en marcha o en evaluación.

Paso 1: inventario honesto de IA en uso

Lista de cada sistema de IA que está operando en la empresa hoy. Incluye los obvios (ChatGPT corporativo, Copilot, agentes específicos) y los menos obvios (la IA dentro del CRM, el asistente de email del proveedor de seguros, el chatbot de la web). Para cada uno, anota: qué hace, quién lo usa, qué datos toca, qué decisiones afecta. Esto se hace en un Excel en una mañana y es la base de todo lo demás.

Paso 2: clasificación rápida

Por cada sistema, marca si toma o influye sobre decisiones del Anexo III (selección de personal, crédito, acceso a servicios esenciales, biometría, infraestructura crítica). Si la respuesta es sí en al menos uno, ese sistema es candidato a alto riesgo y entra en el plan de cumplimiento de aquí a diciembre de 2027. Si es no en todos, sigue habiendo obligaciones (transparencia, alfabetización), pero el listón es bajo.

Paso 3: alfabetización IA antes de junio

Sesión interna de dos horas con el equipo que usa IA. Qué hace cada herramienta, qué no debe hacer, cómo levantar la mano. Documentar la sesión: fecha, asistentes, contenido. Es el cumplimiento más barato del Reglamento y el más visible si alguien pregunta.

Paso 4: política mínima de uso

Una página firmada por todo el equipo: qué herramientas están aprobadas, qué información NUNCA se pega en una IA externa, a quién avisar cuando aparece una herramienta nueva. Esto cubre buena parte del riesgo operativo y prepara el terreno para la documentación más formal que llegará en 2027.

Paso 5: evaluación serena del año que viene

Aprovecha el aplazamiento para hacer las cosas con criterio. Si tu empresa estaba a punto de comprar un agente vertical "para llegar a agosto", revisa la decisión sin presión. Probablemente cambias de proveedor o cambias de alcance. Como vimos cuando explicamos cuándo no es buena idea usar IA en tu empresa, hay procesos donde meter IA es invertir mal y la regulación no es el motivo principal para no hacerlo: es solo una ayuda para parar.

El aplazamiento no anula la dirección. Sigue siendo cierto que las empresas que diseñan sus despliegues de IA con criterio humano y permisos mínimos, como vimos en el reciente caso PocketOS, son las que evitan los desastres. La regulación va detrás de ese principio, no delante.

Por qué se ha aplazado y qué dice esto del rumbo regulatorio

El acuerdo del 7 de mayo no nace del cielo. Llevaba meses gestándose una conversación pública entre la Comisión, los Estados miembros y la industria sobre la dificultad real de cumplir las obligaciones del Anexo III en agosto de 2026, especialmente para empresas pequeñas que dependen de proveedores que tampoco habían terminado sus propias certificaciones. La presión vino de varios sitios a la vez: industria, asociaciones empresariales y algunos Estados miembros que veían un riesgo de dejar a las pymes en desventaja frente a empresas no europeas operando los mismos sistemas sin las mismas exigencias.

El aplazamiento es, en la práctica, un realineamiento: la UE no afloja la línea regulatoria, la espacia. La dirección sigue siendo la misma. Sistemas de alto riesgo bajo control, transparencia con las personas, supervisión humana en lo que importa, prohibición taxativa de las peores prácticas. Lo que cambia es el calendario.

Para una pyme, la lectura estratégica es esta: el reloj del cumplimiento real lo marca tu cliente, no el Diario Oficial. Cuando un cliente corporativo te pida documentación sobre cómo usas IA en sus datos, esa fecha no se aplaza. Y va a empezar a ocurrir mucho antes de diciembre de 2027.

Recursos para profundizar sin perderse

Si después de leer esto quieres entender mejor el marco completo del AI Act y cómo encaja con la realidad operativa de una pyme, hay tres lecturas que recomendamos en este blog. La primera es nuestra guía sobre IA con criterio humano, que explica por qué el principio de supervisión humana del Reglamento no es burocracia: es buena práctica de diseño. La segunda es la entrada sobre agentes de IA para pymes, donde se ve qué tipo de despliegue tiene sentido para empresas pequeñas. Y la tercera es el análisis sobre cuánto cuesta automatizar con IA en una empresa, que ayuda a calibrar la inversión en el contexto del coste regulatorio del cumplimiento.

El texto consolidado del Reglamento europeo de Inteligencia Artificial está disponible en el Diario Oficial de la UE (Reglamento UE 2024/1689). La nota de prensa del 7 de mayo de 2026 sobre el aplazamiento se publicó en la web del Consejo Europeo. Para análisis legal profundo, consulta directamente con un despacho especializado en derecho digital.

La buena noticia con letra pequeña

El acuerdo del 7 de mayo es una buena noticia real para cualquier pyme española que tenga IA en uso. Da margen, baja la presión y permite hacer las cosas con criterio. Y es una buena noticia con letra pequeña que conviene leer: las prácticas prohibidas siguen prohibidas, la transparencia sigue siendo exigible y la alfabetización IA se cumple con dos horas bien usadas esta misma semana.

Lo que cambia es el calendario de cumplimiento serio. Lo que no cambia es la necesidad de tener tu uso de IA bajo control. La regulación va a llegar igual; la única diferencia es que ahora puedes llegar tú primero, con un despliegue bien pensado en lugar de uno hecho con prisa.

Si quieres una conversación sobre cómo está tu empresa hoy frente a estas obligaciones, o sobre cómo diseñar un despliegue de IA que cumpla por defecto sin tener que reformar nada en 2027, escríbenos. La mejor inversión que puedes hacer con los 16 meses extra es no necesitarlos.